Eine zentrale Plattform für alle KI-Anwendungsfälle im Unternehmen, von einfachen Chatbots bis hin zu komplexen Multi-Agenten-Systemen. Der AI Hub ist ein praxiserprobter Beschleuniger mit produktionsreifem Code für eine schnelle Implementierung.

Eine zentrale Plattform für alle KI-Anwendungsfälle im Unternehmen, von einfachen Chatbots bis hin zu komplexen Multi-Agenten-Systemen. Der AI Hub ist ein praxiserprobter Beschleuniger mit produktionsreifem Code für eine schnelle Implementierung.

Eine zentrale Plattform für alle KI-Anwendungsfälle im Unternehmen, von einfachen Chatbots bis hin zu komplexen Multi-Agenten-Systemen. Der AI Hub ist ein praxiserprobter Beschleuniger mit produktionsreifem Code für eine schnelle Implementierung.

Der Hype der LLM-Fortschritte in den vergangenen Jahren hat in vielen Unternehmen eine Welle von AI-Initiativen ausgelöst. In kurzer Zeit entstanden zahlreiche Proof-of-Concepts und erste Produktivanwendungen, von Chatbots über Dokumentenanalyse bis zu spezialisierten Assistenten für verschiedene Fachbereiche.

Doch mit der wachsenden Anzahl an Use Cases zeigt sich ein wiederkehrendes Muster: Jede neue Anwendung wird als eigenständige Lösung entwickelt. In den Projekten entstehen individuelle Lösungen mit spezifischen technischen Stacks, dedizierter Infrastruktur und maßgeschneiderten Benutzeroberflächen. Was als agiler Ansatz beginnt, wird schnell zum Skalierungsproblem.

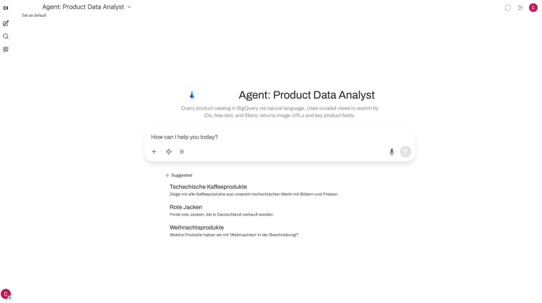

Eine zentrale Plattform für alle AI-Anwendungsfälle im Unternehmen, von einfachen Chatbots bis zu komplexen Multi-Agent-Systemen. Der AI-Hub ist ein battle-tested Accelerator mit production-ready Code für schnelle Implementierung. Nutzer greifen über eine einzige Plattform auf alle AI-Funktionen zu. Vom einfachen Chat bis zur komplexen Workflow-Automatisierung. Dadurch können neue Use Cases in Tagen statt Monaten entwickelt werden. Zentrale Plattform für alle Use Cases Einheitlicher Zugang zu Chatbots, Dokumentenanalyse, Code-Assistenten, Datenanalyse und spezialisierten Agenten. Alles an einem Ort. Simple wie komplexe Cases darstellbar Single Agents für direkte Aufgaben, Multi-Agent-Orchestrierung für komplexe Workflows, Custom Tools für unternehmens-spezifische Integrationen. Schneller Time-to-Value Neue Use Cases sind in Tagen statt Monaten produktiv. Wiederverwendung von Tools, Prompts und Integrationen über alle Anwendungsfälle hinweg. Cloud-Agnostic Deployment Ready-to-deploy Code für Google Cloud & Microsoft Azure. Auch hybride Szenarien sind möglich.

Die Architektur des synvert AI-Hubs folgt dem Prinzip der Trennung der involvierten Systemschichten. In bisherigen GenAI-Implementierungen sind UI, Business-Logik und Datenintegration oft eng miteinander verzahnt. Das Ergebnis: Änderungen am Frontend erfordern Backend-Deployments. Neue Tool-Integrationen bedeuten UI-Updates. Die Einbindung eines neuen Sprachmodells zieht Änderungen durch den gesamten Stack. Diese Kopplungen führen zu weniger Flexibilität bei Anpassungen. Der AI-Hub durchbricht dieses Muster durch konsequente Modularisierung über standardisierte Schnittstellen. Die Agent Logik ist unabhängig vom Frontend und kann auch in Automatisierungsprozessen genutzt werden. Neue Sprachmodelle lassen sich einfach integrieren, Tools können über mehrere Use Cases und Agents hinweg verwendet werden. Unabhängige Skalierung Die Agent Runtime skaliert unabhängig von UI und Tools. Ressourcen-intensive Workloads werden isoliert behandelt. Tool-Wiederverwendung Die Tool Server werden über alle Agents und Use Cases hinweg genutzt. Security & Compliance Sensible Daten und Business-Logik bleiben in kontrollierten Schichten isoliert. Audit-Trails und Access-Control auf jeder Ebene implementierbar. Standards-Based OpenAI-kompatible APIs, Open-Source Technologien, Model Context Protocol (MCP), Standard-Observability und keine Vendor Lock-ins.

Wir haben viele unserer Kunden auf ihrer GenAI-Journey begleitet. Von den ersten PoCs über MVP-Deployments bis zu unternehmensweiten Rollouts. Dabei kristallisierte sich ein wiederkehrendes Muster heraus: Die erfolgreichsten Implementierungen folgten alle ähnlichen Architekturprinzipien: modularer Aufbau, Trennung von UI und Runtime, wiederverwendbare Tool-Integration. Aus diesen Projekterfahrungen haben wir den AI-Hub als standardisierten Accelerator entwickelt. Statt jedes Mal bei Null anzufangen, starten Kunden heute mit battle-tested Code, bewährten Patterns und Production-ready Infrastructure. Das Ergebnis: Eine deutlich kürzere Zeit beim initialen Setup, von Monaten zu Wochen bei der Skalierung. Ist die Plattform-Frage grundsätzlich gelöst, können sich Teams auf das Wesentliche konzentrieren: die Use Cases, die wirklichen Mehrwert liefern. Nicht die Infrastruktur entscheidet über den Erfolg, sondern ob GenAI das einlöst, was es verspricht. Echte Unterstützung im Arbeitsalltag, spürbare Effizienzgewinne und Lösungen für konkrete Business-Herausforderungen.

Sie erhalten in Kürze eine E‑Mail zur Aktivierung Ihres Kontos.